"LinearRegression" (机器学习方法)

- Predict 的方法.

- 使用特征的线性组合预测值.

详细信息与子选项

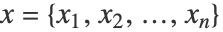

- 使用数值特征

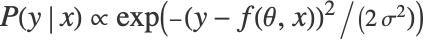

的线性组合,线性回归预测数值输出 y. 条件概率

的线性组合,线性回归预测数值输出 y. 条件概率  根据

根据  ,其中

,其中  被模拟.

被模拟. - 参数向量 θ 的估计是根据最小化损失函数

![1/2sum_(i=1)^m(y_i-f(theta,x_i))^2+lambda_1sum_(i=1)^nTemplateBox[{{theta, _, i}}, Abs]+(lambda_2)/2 sum_(i=1)^ntheta_i^2 1/2sum_(i=1)^m(y_i-f(theta,x_i))^2+lambda_1sum_(i=1)^nTemplateBox[{{theta, _, i}}, Abs]+(lambda_2)/2 sum_(i=1)^ntheta_i^2](Files/LinearRegression.zh/5.png) 得到,其中,m 是例子数,n 是数值特征数.

得到,其中,m 是例子数,n 是数值特征数. - 可以给出以下子选项:

-

"L1Regularization" 0 损失函数中的  值

值"L2Regularization" Automatic 损失函数中的  值

值"OptimizationMethod" Automatic 使用何种优化方法 - "OptimizationMethod" 选项的可能设置是:

-

"NormalEquation" 线性代数方法 "StochasticGradientDescent" 随机梯度方法 "OrthantWiseQuasiNewton" orthant-wise quasi-Newton 方法 - 对于这种方法,Information[PredictorFunction[…],"Function"] 给出简单的表达式根据特征计算预测值.