"LogisticRegression" (机器学习方法)

- Classify 的方法.

- 通过特征线性组合的逻辑斯蒂函数模拟类别概率.

详细信息与子选项

- "LogisticRegression" 通过数值特征

,

,  的线性组合模拟各个类别的对数概率,其中

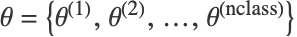

的线性组合模拟各个类别的对数概率,其中  对应于类别 k 的参数. 参数矩阵

对应于类别 k 的参数. 参数矩阵  的估计通过最小化损失函数

的估计通过最小化损失函数 ![sum_(i=1)^m-log(P_(theta)(class=y_i|x_i))+lambda_1 sum_(i=1)^nTemplateBox[{{theta, _, i}}, Abs]+(lambda_2)/2 sum_(i=1)^ntheta_i^2 sum_(i=1)^m-log(P_(theta)(class=y_i|x_i))+lambda_1 sum_(i=1)^nTemplateBox[{{theta, _, i}}, Abs]+(lambda_2)/2 sum_(i=1)^ntheta_i^2](Files/LogisticRegression.zh/5.png) 得到.

得到. - 可以给出下列选项:

-

"L1Regularization" 0 损失函数中  的值

的值"L2Regularization" Automatic 损失函数中  的值

的值"OptimizationMethod" Automatic 使用什么方法 - "OptimizationMethod" 的可能设置包括:

-

"LBFGS" Broyden–Fletcher–Goldfarb–Shanno 算法的有限内存 "StochasticGradientDescent" 随机梯度法 "Newton" 牛顿法